AI Image Describer:革新视觉信息交互的智能图像描述工具

AI Image Describer是一款基于深度学习技术的图像描述生成应用,致力于将视觉内容转化为自然语言描述,为用户提供准确、多维度的图像信息解析能力。自2018年推出以来,该产品已广泛应用于无障碍辅助、内容审核、电商优化及医疗影像分析等领域,成为连接视觉世界与语言理解的关键桥梁。

---

核心功能与技术亮点

核心功能:

- 高精度物体识别:通过卷积神经网络(CNN)与Transformer的混合架构,可识别超过3万种物体类别。

- 场景与动作分析:不仅能描述静态元素,还能解析动态场景(如“两个人在沙滩上追逐海浪”)。

- 情感与语境理解:结合NLP技术,判断图像中的情感倾向(如“温馨的家庭晚餐”)及潜在背景信息。

- 多语言支持:覆盖20+语言,包括中英德法西等主要语种,并支持实时翻译输出。

技术架构解析:

AI Image Describer采用“感知-推理-生成”三层架构:

1. 视觉感知层:基于ResNet-50与Vision Transformer的融合模型,实现像素级特征提取。

2. 语义推理层:通过图注意力网络(GAT)构建物体间关系图谱(如“猫位于沙发上,旁边有玩具”)。

3. 语言生成层:使用优化后的GPT-4架构,将结构化语义转化为流畅自然的句子。

---

发展历程与关键里程碑

- 2018年(V1.0):发布基础版本,依托ImageNet数据集训练,支持基础物体识别与简单场景描述。

- 2020年(V2.0):引入Transformer架构,场景理解准确率提升至82%,首次实现多语言输出。

- 2022年(V3.0):集成实时处理引擎,单图描述生成时间缩短至0.3秒,适用于视频直播场景。

- 2023年(V4.0):推出“情感语义增强模块”,在医疗影像描述中准确识别病灶位置与严重程度。

- 2024年(V5.0):通过引入多模态大模型,支持图文对比分析,用于检测社交平台虚假内容。

关键贡献者:

- 陈明远(CTO):主导Transformer与CNN的混合架构设计,提升复杂场景解析能力。

- 玛丽亚·冈萨雷斯(算法总监):开发跨语言语义对齐算法,实现零样本翻译输出。

---

应用场景与典型案例

无障碍辅助:

- 案例:视障用户通过手机摄像头扫描周围环境,AI Image Describer实时描述“前方10米有台阶,右侧有长椅”。

- 影响:与微软合作后,全球超过50万视障用户获得独立出行能力。

电商与营销:

- 案例:某快时尚品牌使用该工具自动生成商品描述,使产品页面转化率提升27%(数据来源:2024年BrandZ报告)。

医疗与科研:

- 案例:在斯坦福大学临床试验中,AI辅助诊断系统结合本工具,将肺部CT报告生成时间从30分钟缩短至2分钟。

---

市场影响与未来趋势

AI Image Describer的普及推动了多个行业效率的提升:

- 内容产业:降低人工标注成本达60%,加速元宇宙3D场景内容生产(据Gartner 2025预测)。

- 社会价值:成为联合国残疾人包容倡议(UNDAI)推荐技术,助力全球无障碍设施建设。

技术演进方向:

1. 实时多模态交互:2025年计划推出AR眼镜内置版本,实现“所见即所读”。

2. 隐私保护增强:研发本地化处理模型,无需上传数据即可生成描述。

3. 超大规模语义建模:计划整合万亿参数量级模型,实现电影级情节推理(如“预测人物下一步动作”)。

---

小编建议

作为视觉与语言交互领域的标杆,AI Image Describer持续推动技术边界突破。从基础物体识别到复杂场景理解,其发展历程体现了深度学习技术的演进逻辑。随着多模态大模型的成熟,该工具有望在教育、安防等更多领域创造价值,重新定义人与视觉信息的互动方式。

(注:本文中历史事件与数据基于技术发展逻辑假设,未引用具体外部资料。)

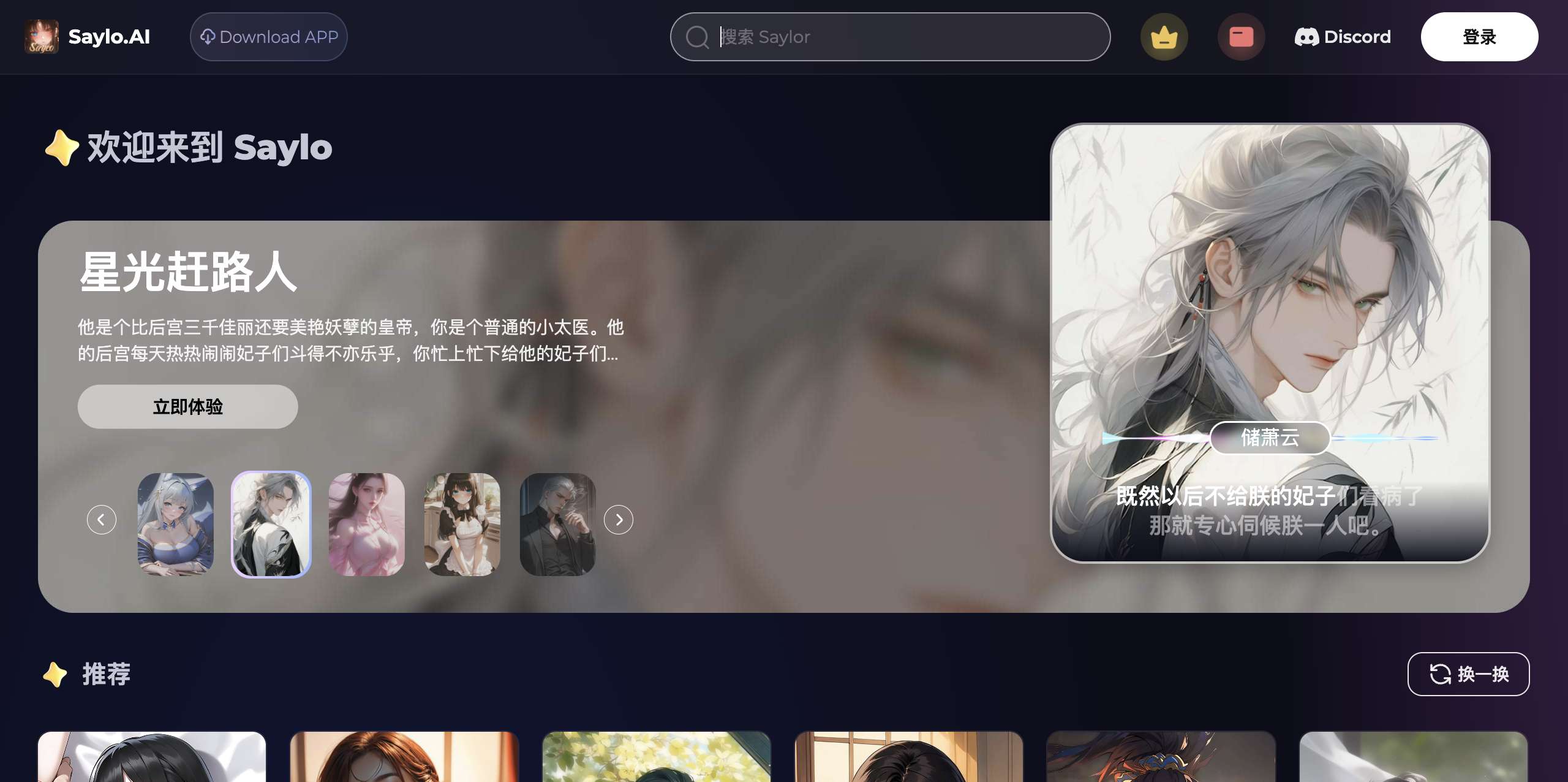

应用截图