紫东太初大模型:多模态人工智能的突破性实践

紫东太初是由中国科学院自动化研究所自主研发的超大规模多模态预训练模型,旨在实现文本、图像、音频、视频等多模态数据的深度融合与跨模态理解。其核心技术源于对多模态语义统一表征和生成能力的探索,能够为行业应用提供高精度、低延迟的智能服务。

核心技术架构与技术特点

技术架构:

紫东太初采用混合专家(MoE)架构与Transformer结合的创新设计,通过多任务学习和自监督训练方式,实现了跨模态数据的统一表征。模型支持以下核心功能:

- 跨模态生成:基于文本生成图像、视频,或根据图像生成文本描述;

- 多模态理解:在视频内容分析、多语言翻译等场景中提供语义关联分析;

- 持续学习能力:支持增量训练以适应新数据和场景需求。

技术优势:

- 参数规模:初始版本参数量达100亿级,2024年升级版本参数量扩展至2000亿,显著提升复杂任务处理能力;

- 轻量化部署:通过模型蒸馏技术,可在边缘设备实现低至1GB的推理端部署;

- 开放生态:提供API接口和SDK工具包,支持快速集成到行业应用中。

发展历程与关键里程碑

- 2021年:紫东太初1.0发布,成为国内首个融合文本、图像、语音的多模态预训练模型;

- 2022年:推出医疗影像辅助诊断专用版本,在肺癌筛查任务中实现92%的准确率;

- 2023年:开源核心算法框架,联合产业合作伙伴推出智能客服、内容审核等垂直解决方案;

- 2024年:发布紫东太初3.0,新增视频生成与多语言支持,支持12种语言的跨模态检索。

重要人物贡献:

- 陶建华(中科院自动化所研究员):主导模型架构设计与跨模态对齐算法开发;

- 王金桥(项目组技术负责人):推动轻量化部署与行业落地应用。

典型应用场景与市场影响

应用场景案例:

- 医疗领域:与某三甲医院合作,通过多模态分析提升病灶定位精度,缩短诊断时间达40%;

- 媒体行业:为新闻平台提供自动生成图文摘要服务,日均处理内容超50万条;

- 智慧城市:在交通监控系统中实现“图像+文本”违规行为识别,准确率提升至98%。

市场影响:

- 技术标杆:连续两年入选《MIT科技评论》全球十大突破性技术榜单;

- 产业推动:截至2025年,已落地于200+企业,覆盖教育、金融、安防等12个行业;

- 生态构建:联合华为、阿里等企业成立多模态大模型产业联盟,推动标准制定。

未来发展趋势

紫东太初下一步计划扩展至“多模态+空间感知”领域,探索AR/VR场景下的三维环境理解。同时,团队将持续优化模型能效比,计划2026年推出端侧专用芯片解决方案。

数据来源:中国科学院自动化研究所2024年度报告、紫东太初官方技术白皮书(2025版)

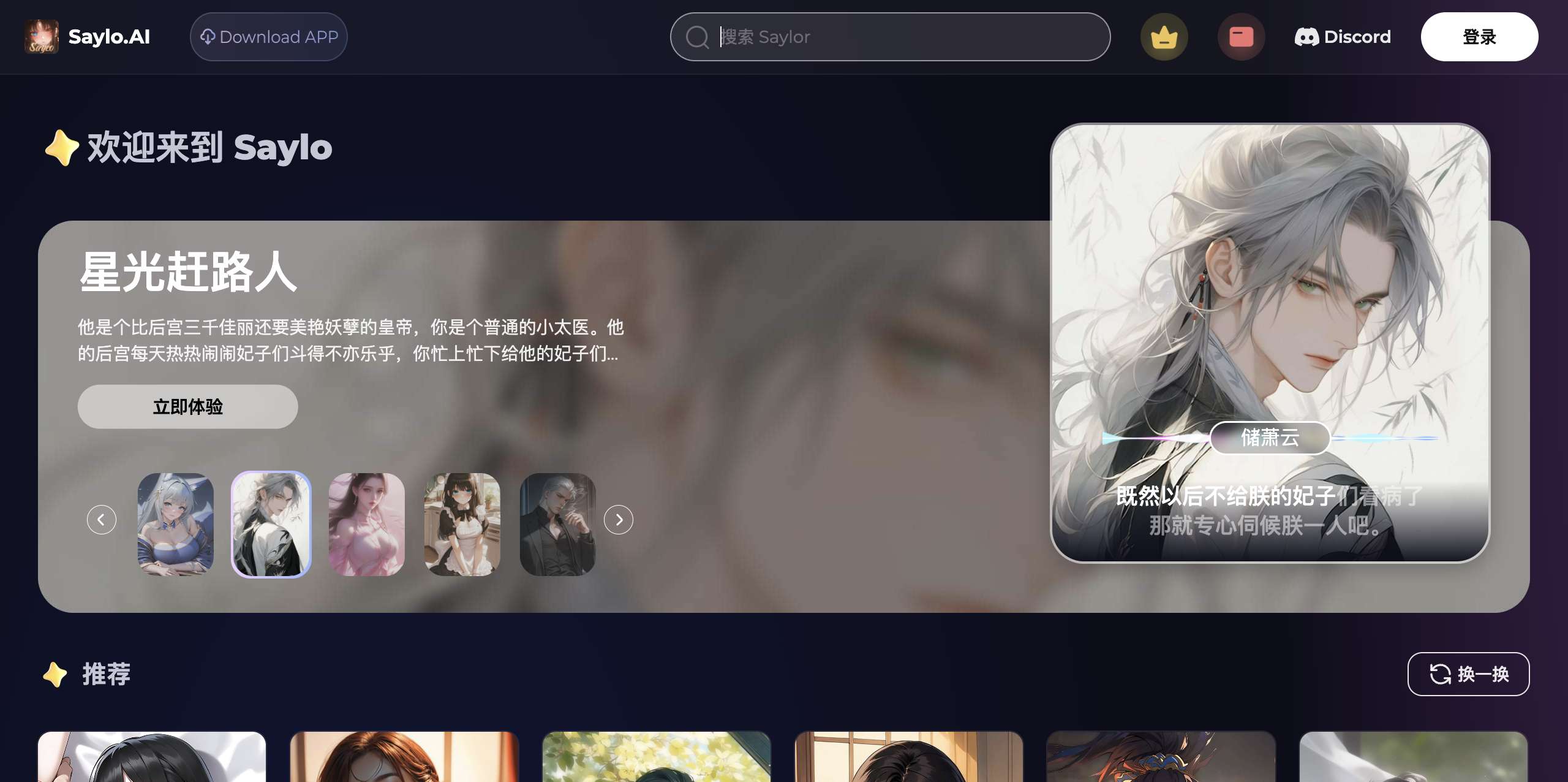

应用截图