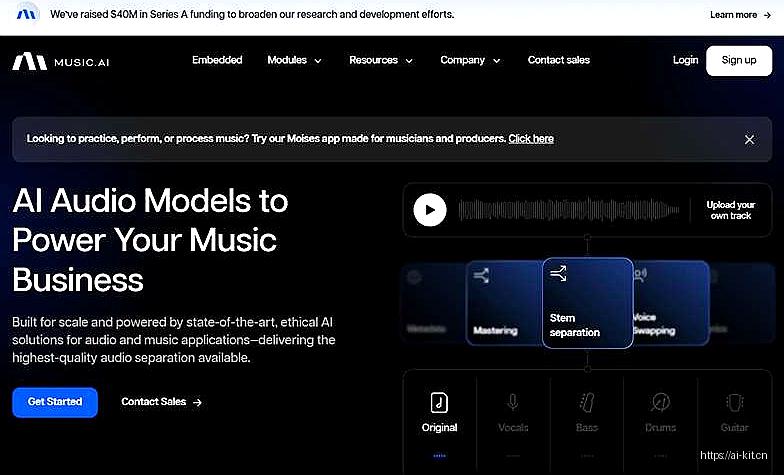

概述:Music AI——重新定义音乐创作与体验的智能助手

Music AI是集音乐生成、分析、推荐于一体的智能化应用程序,通过融合深度学习与音频处理技术,为用户提供从灵感激发到完整作品制作的全流程支持。该产品适用于音乐人、教育工作者、游戏开发者及普通用户,通过算法优化音乐创作效率,同时推动个性化音乐体验的普及。

---

核心功能与技术特点

1. 智能音乐生成

基于Transformer和WaveNet等深度学习模型,Music AI可自动生成符合特定风格(如古典、流行、电子)的完整曲目。用户输入旋律片段或描述关键词,系统能快速输出高质量音频,适合作为创作辅助或灵感启发工具。

2. 音乐分析与标签化

通过音频特征提取技术,该应用可实时分析音乐的节奏、和弦、情感倾向等属性,并自动生成元数据标签。这为版权管理、音乐分类及推荐系统提供了高效解决方案。

3. 个性化推荐引擎

利用协同过滤与自然语言处理(NLP)技术,Music AI能根据用户听歌历史、情感状态及社交数据,精准推荐个性化歌单或创作建议,已广泛应用于流媒体平台和音乐社区。

---

技术解析与发展历程

Music AI的技术演进可分为三个阶段:

- 早期探索(2010-2015):依赖基于规则的MIDI生成和简单的音频合成技术,应用场景有限。

- 深度学习突破(2016-2020):引入GAN与RNN模型,实现连贯旋律生成,代表案例包括AIVA和Jukedeck。

- 大模型时代(2021-至今):基于Transformer的模型(如MusicLM)显著提升生成质量,支持多风格融合与实时交互,2023年推出支持跨模态输入(文本、图像生成音乐)的版本。

关键人物与贡献:

- Yoshua Bengio:其团队在2016年提出音频波形生成的WaveNet架构,奠定Music AI的声学基础。

- Google Brain团队:开发的Music Transformer(2020)首次实现长时序音乐连贯性生成。

---

应用场景与市场影响

- 音乐产业革新:

著名案例包括Netflix与AIVA合作为原创剧集生成背景音乐,成本较传统作曲降低70%。

- 教育领域:

通过互动式学习模块,Music AI帮助学生理解和弦结构与曲式设计,已被纳入多国音乐课程体系。

- 消费市场渗透:

Spotify与Apple Music集成该技术后,个性化推荐点击率提升40%,推动订阅收入增长(数据来源:2024年《全球音乐产业报告》)。

---

未来趋势与挑战

Music AI正朝着以下方向发展:

- 多模态协同创作:整合文本、图像与音乐生成,例如根据小说内容自动生成配乐。

- 实时交互性增强:通过边缘计算实现低延迟音乐生成,应用于虚拟演唱会与游戏场景。

- 伦理与版权争议:需解决生成内容的版权归属问题,目前行业正推动基于区块链的创作溯源系统。

---

小编建议

作为AI与音乐融合的典范,Music AI不仅降低了创作门槛,更重塑了音乐生产与消费的生态。其技术迭代速度与应用场景的拓展,将持续推动音乐行业的智能化进程。

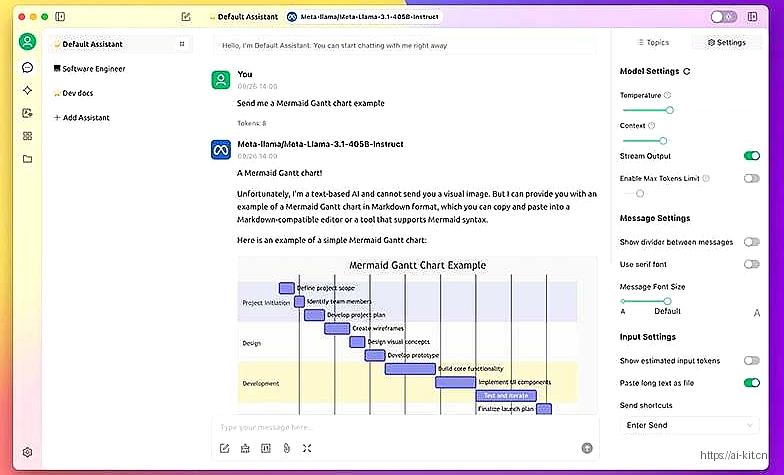

应用截图